В останні тижні та місяці стають все складніше врятуватися від дивних та маніпулятивних образів AI, що з’являються скрізь у Facebook та інших соціальних мережах, особливо у відданих ізраїльських групах для матерів, солдатів чи шанувальників релігійних діячів та рабинів.

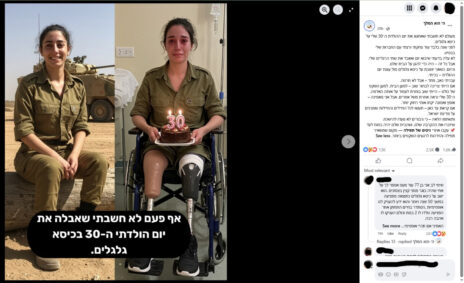

Вони, як правило, включають фотографії солдатів з протезуваннями, які перейшли прямо з поля бою на весілля чи народження, виснажені та плаксиві медсестри, які піклуються про поранених бійців, працьовитих робітників із синіми комірами, які просто просять слова заохочення, або чарівні маленькі діти, що святкують дні народження без матері.

Зображення виглядають одночасно реалістичними, але тривожними. Цифри виглядають дуже локальними та знайомими, але почуття відчужене та штучне. Супровідні підписи зазвичай здаються відчайдушною і прозорою спробою стиснути реакції або акції послідовників.

Хоча більшість із нас сміються з цього явища або дивуються, що за ним стоїть, ці образи мають незліченну кількість лайків і ділиться у Facebook та інших мережах, іноді в дуже популярних групах, таких як “Твіт”; Їх просувають алгоритми платформ і йдуть вірусними. Інтереси та мотивації, що стоять за ними, залишаються прихованими – але шкода, яка буде наслідком, безумовно, вже може бути передбачена.

Забруднення AI

Це глобальне явище створення та розповсюдження синтетичних, емоційно маніпулятивних образів, пристосованих для соціальних мереж, заслужило прізвисько “Slop” або “забруднення AI”. Подібно до спаму, який залишив нашу електронну пошту після того, як ми прийняли його як основний робочий інструмент, ці зображення тепер загрожують затопленням соціальних медіа та всього Інтернету візуальним та емоційним сміттям.

https://www.youtube.com/watch?v=t04_2szly2o

Доступність та простота створення реалістичних зображень за допомогою інструментів AI у поєднанні з алгоритмічним зміщенням платформ до емоційно провокаційного та сльозогірного контенту перетворили їх на потужний інструмент для тих, хто прагне створити цільову аудиторію для майбутньої монетизації, цілеспрямованого розподілу-або сприяння шахрайству та дезінформації.

Обличчя та фон змінюються між країнами та мовами, але принцип залишається однаковим. У США та Аргентині розповсюджуються зображення двірників, пожежників та працьовитого лікарі, які просять “прості благословення”; У Франції це були б працьовиті фермери, які продають сир, вино та сільськогосподарську продукцію на сільських ринках; В арабськомовних мережах це була б голова, яка виготовляла лаваша хліба на підлозі, тоді як у холодній Росії ми побачили працьовитим водієм вантажівки, який прямує до роботи рано вранці.

Різні обличчя, однакова мета

Різні обличчя, різні контексти та різні мови – з однією рівномірною метою. Щоб стиснути лайки та акції користувачів у різних країнах, щоб відзначити та вирощувати визначену цільову аудиторію та перетворити їх на зручний дохід та цілі для рекламодавців або орієнтованих на порядок денний-під егідою алгоритмів мереж.

Підроблені зображення, створені за допомогою штучного інтелекту для збору інформації від серферів

Зображення публікуються на різних сторінках та групах – від груп, присвячених релігії та традиціях, через футбольні фан -групи та політичну активність, до мемівних сторінок, і їм вдається здобути популярність та генерувати залучення. Як би дивні та штучні виглядали образи, люди у всьому світі вважають, що вони справжні, і поділяються ними несамовито.

В Ізраїлі зображення розповсюджуються в дуже конкретних групах, ті, що присвячені щоденним урокам Тори чи фігурам з такими наступними, як рабини та співаки. Зв'язок між синтетичними зображеннями, патріотичними розповідями та алгоритмами платформ, керованими емоціями, перетворює ці зображення на потужний збір даних та машину сегментації аудиторії. Використання, до яких вони можуть бути використані, є різноманітними, іноді шкідливими і навіть злочинними.

Численні загрози

Цей механізм може бути дуже ефективним для рекламодавців та мисливців на ведучих – але також для аферистів, які експлуатують місцевий та національний контекст війни та упередженості соціальних медіа, щоб отримати експозицію. Збір номерів телефонів, переведення в закриті групи WhatsApp, вигаданий збір коштів та інші засоби та способи вилучення грошей у користувачів.

Підроблені зображення, створені за допомогою штучного інтелекту для збору інформації від серферів

Це не просто аферистри, що експлуатують співчуття та емоції літніх, традиційних чи інших груп населення. Бази даних, групи та залучення, створені за допомогою емоційно провокаційних синтетичних зображень, можуть стати потужною зброєю і для політиків, і в битві за свідомість та переміщення громадськості до виборчих дільниць.

Крім того, масове розповсюдження та затоплення цих помилкових та емоційних образів також є справжньою гносеологічною атакою – прямим нападом на нашу здатність вірити в те, що ми бачимо, і про вагу істини та фактів у соціальних медіа. Чим більше мереж затоплені такими образами, тим більше наша здатність вірити, що ми бачимо, що ми просто не повіримо.

Смерть спільної правди та відповідальності платформи

Незабаром ми станемо суспільством, де неможливо проводити дискусії чи дебати на будь -яку тему, оскільки немає фактів чи доказів, на які ми можемо погодитися. Історія про голод у Газі та пошкодження війни взагалі є хорошим доказом цього – навіть суворі та шокуючі образи, які були перевіряються та перевіряються знову і знову журналістами та очевидцями, стали предметами політичного та партизанського протистояння. Перевірені візуальні докази зон катастроф поступово втрачають свою владу переконати та стати основою для обговорення.

Ті, хто повинен брати на себе відповідальність за цю історію, – це, звичайно, платформи, які дозволяють самому існувати цього явища. Сьогодні вже є досить багато хороших автоматичних інструментів, які можуть оцінити, чи зображення є AI-генерацією. Якщо мова йде про типові емоційні та маніпулятивні підписи, це не повинно бути надто складним завданням для виявлення польоту AI.

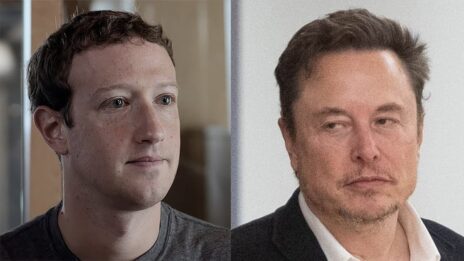

Багатомільярнери Елон Маск (праворуч), який контролює Twitter (X), та Марка Цукерберга, який контролює Facebook та Instagram (Фотографії: Скріншот та Кобі Гедеон, GPO)

Але Meta, власник Facebook та Instagram, не хоче про це чути, а також не робити інших соціальних мереж. Наразі на платформі немає механізму захисту, який попереджає користувачів, коли зображення не є справжнім. Навпаки: алгоритм бере активну роль у розповсюдженні та рекомендації цих фальшивих зображень та робить їх вірусними.

Це, звичайно, лише один сучасний приклад явища, яке грає в руки аферистів та маніпуляторів, шкодить демократичним виборам у всьому світі та саботає здатність підтримувати здоровий публічний дискурс.

Цукерберг, Маск та інші власники соціальних медіа відмовляються брати на себе відповідальність за зміст, який публікують їх платформи, та за їх соціальну та політичну роль.

Наразі зупиняє платформи захищати користувачів, це не технологія, а політика. Політика, яку визначають люди. Власники та менеджери соціальних мереж, які не мають інтересу до боротьби з цим явищем, та законодавцями, які не мають інтересу змусити їх це робити.

Едан Рінг – це лектор та дослідник комунікацій, віце -прем'єр -міністр та суспільство в Ізраїльській інтернет -асоціації

Стаття вперше була опублікована на івриті 18 серпня.