Незважаючи на те, що їх основна «юридична» мета залишається спамом та рекламою, ці платформи зараз становлять значну загрозу для демократії, як розкривають розслідування YNET та інших. Ідентифікація ботів колись була прямою через їх повторювані, неприродні дії, але нові платформи змінили гру.

Нещодавнє дослідження університету Південної Каліфорнії, опубліковане сьогодні в USC, виявило, що під час президентських виборів у США 2020 року, рахунки BOT зросли більш розвиненими, поширюючи теорії політичної змови.

Дослідник Еміліо Феррара сказав міжнародним ЗМІ: “Боти посилюють споживання контенту в межах однієї політичної бульбашки, посилюючи ефект ехо -камери, коли люди стикаються лише з поглядами, що узгоджуються зі своїм”.

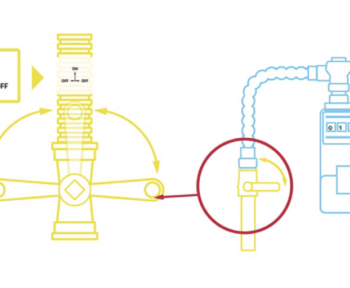

Відео, простежене до Reddit Post, що рекламує автовірусну платформу поряд з інструментами для переміщення екрана, такими як Panda Manual, демонструє операторів, які керують десятками, здавалося б, реальних облікових записів, кожен з них прив’язаний до виділеного пристрою, що ухиляється від виявлення соціальних медіа.

Використання реальних смартфонів, а не віртуальних налаштувань, уникає підозр із фільтрів соціальних медіа, оскільки кожен обліковий запис, який видається, пов'язаний з одним пристроєм, маскуючи координовану діяльність однією сутністю.

Ця технологія, викрита в 2019 році Yedioth Ahronoth та New York Times розслідування «людських ботів», що поширюють політичні повідомлення для партії Лікуд Ізраїлю, тепер підсилюється з такими платформами, як Autoviral. Метод, використовуючи реальні пристрої, ефективно підвищує ехо -палату, загрожуючи демократичним процесам у всьому світі.

Дослідження президентських та європейських виборів США показують, що боти посилюють оманливі або помилкові політичні наративи, формуючи публічний дискурс. У Великобританії дослідження пов’язали автоматизовані мережі з референдумом Brexit 2016 року, невпинно просуваючи проекситові повідомлення, що вплинули на результат.

Незважаючи на зусилля соціальних медіа протистояти ботам, боротьба нагадує технологічну гонку озброєння, коли боти переробляють тактику ухилення та компанії, які готуються для покращення виявлення.

За іронією долі, регулятори, які політично отримують користь від цих ботів, тримають силу, схожі на “кота, що охороняє крем”. Боротьба з фальшивими новинами та дезінформацією вимагає багатогранного підходу як від платформ, так і з боку користувачів, які повинні навчитися помітити упереджений або помилковий вміст.